●子どもに見せたくない情報とは何か?

●インターネット上では今、何が問題か?

●子どもに見せたくないサイトへの対応策

●インターネット業界による自主規制

●技術的対策

●法規制

●ホットライン

●利用者のメディアリテラシーの向上

●海外の動向:法規制

●海外の動向:自主規制

昨年のインターネット白書によると、我が国のインターネット利用者数は推計で約6,300万人とされ、国民の半数がインターネットを利活用してます。特に家庭への普及率は52.1%と、初めて過半数を越えました。また、携帯電話からの利用者数も前年比115%となっており、こちらも着実に増加しています。このようにインターネットはすでに個人レベルにまで普及してきており、もはや、私たちの生活にとって欠かせないものと言っても過言ではありません。

一方でインターネットに起因する事件やトラブルも増加しています。昨今の架空料金請求や迷惑メール、プライバシー侵害問題、ネット集団自殺、殺害などの犯行予告、出会い系サイトによる児童買春問題など情報発信の自由や匿名性といったインターネットの特性を悪用したものが多く見受けられるようになりました。

このパンフレットでは、これらインターネット上に氾濫する有害情報から子どもを守るため、私たちができることに焦点をあてています。まず、インターネット上の子どもに見せたくない情報について取り上げ、次にそれらの情報への対応策として、自主規制、技術的対策、法規制、ホットライン、メディアリテラシーといった取組みを紹介しています。最後に、海外各国で行われている法規制や自主規制に関する取組みを紹介しています。

このパンフレットを通して、より多くの人が、インターネット上の子どもに見せたくない情報に対して何ができるかを考え、子どもが安心してインターネットを利用できる環境を作っていくことへのきっかけとなれば幸いです。

インターネット上には、たくさんの役に立つ情報、世界各国のニュース、私たちの知識の幅を広げてくれる情報などがあふれています。その反面、ポルノ画像や暴力画像、他人に対する心ない言葉など、子どもに見せたくない情報や大人でさえも見たくない情報もたくさんあります。

インターネット上のポルノ画像や暴力画像といった情報を見たくない人や子どもに見せたくない人は、どのようにしたらよいのでしょうか。こうした情報について、もちろん情報を発信する人の権利もありますが、見たくない人や子どもに見せたくない人の権利もあると考えられます。これは、たばこには吸う人の権利もありますが、たばこの煙を吸いたくない人の権利もあるのと同じことです。

このパンフレットでは、インターネット上の情報の中で、子どもに見せたくない情報に対して私たちができることについて、紹介していきます。

子どもに見せたくない情報とは、子どもの健全な成長に害を与えたり、妨げたりするような情報と言えます。どのような情報が子どもに見せたくない情報かは、個人の価値観や子どもの年齢などによって、変わってきます。子どもがきちんとした教育を受けていれば、ひどい情報であっても、善悪を判断して対処することで、害がないかもしれません。

また、国や文化による受取り方の違いもあります。例えば、大相撲は日本ではれっきとしたスポーツですが、外国では「男性ヌードショー」と受取る人もいます。

このように子どもに見せたくない情報といっても、一概に全員に共通して決めることはできません。しかし、多くの子どもにとって悪影響を与えると思われる情報が存在するのは事実であり、ここではこの情報のことを「有害」情報と呼ぶことにします。

子どもにとって「有害」であると多くの人が考えるような情報を、そのまま放置しておくわけにはいきません。このような観点から、多くの都道府県の青少年健全育成条例では、青少年に対して「著しく性的感情を刺激するもの」や「甚だしく残虐性を助長するもの」「著しく自殺を誘発するもの」「著しく犯罪を誘発するもの」などを有害図書類として規定しています。有害図書類とは、書籍、雑誌、写真、DVD、CD-ROM、ビデオテープなどを指しており、インターネットについては、ほとんどの条例で対象となっていません。

また、インターネット上の膨大な数の情報について、保護者が逐一、子どもに見せたくないかどうかを確認することはできません。インターネット上の情報を子どもに見せなくするための技術的対策として、フィルタリングソフトがありますが、多くのフィルタリングソフトでは情報の善し悪しは定めず、情報をカテゴリごとに分類してリストアップし、カテゴリごとに見せる・見せないの指定をすることになっています。

では、インターネットにおける「有害」情報とは何なのでしょうか。基本的には、都道府県の青少年健全育成条例で定める有害図書類の内容に相当するものが挙げられます。しかし、インターネットは書籍やビデオ、テレビなどの従来のメディアと異なり、誰もが自由に情報を発信でき、情報発信者の匿名性とあいまって、さまざまな種類の有害情報が存在します。そのため、これらの有害情報は、青少年健全育成条例で定める有害図書類の範疇にはおさまらなくなってきており、改めてインターネットにおける「有害」情報とは何かを考える必要があります。

また、情報の作り手がどのような意図で作ったかも重要です。子どもへの性教育情報のように、題材に性的なものが含まれていても、教育的な意図を持って作成された情報は「悪い」とは言えません。ほかにも「小さな子どもが川辺で水浴びをしている写真」は、その写真がどのような文脈で掲載されるかによって「良い」情報にも「悪い」情報にもなりえます。肝心なのは、その情報が「どのような意図をもって作られたか」なのです。

以前からインターネット上に存在する有害な情報としては、アダルトサイト(ポルノ画像や風俗情報)、暴力残虐画像を集めたサイト、他人の悪口や誹謗中傷を載せたサイト、犯罪を助長するようなサイト、毒物や麻薬情報を載せたサイト、ギャンブル情報を載せたサイト、爆発物の作り方を紹介するサイトなどがあります。

アダルトサイトでは通常「18歳未満の入場おことわり」として、子どもの入場制限を行なっています。しかし、確実に年齢を確認する手段がないため、誰でも簡単に入場することができているのが現状です。

アダルトサイトでは、有料コンテンツ販売時にクレジットカード決済を行なっているサイトがあり、クレジットカード情報の入力による年齢確認も可能です。しかし、無料で誰でも見ることができるサンプル画像も数多くあるのです。

また、インターネット上には米国を初めとして、海外のアダルトサイトがたくさんあります。日本ではわいせつ画像として違法なものでも、海外では合法である場合があります。インターネットではそうしたサイトも、いとも簡単に閲覧できてしまうのです。

これらの情報の多くは、都道府県の青少年健全育成条例の有害図書類の規定を用いて分類することが可能です。いくつかの条例ではインターネットの「有害情報」に有害図書の規定を適用しています。しかし、インターネットは従来のメディアの形態と異なるため、具体的な指定方法について、検討を進めていく必要があります。

出会い系サイトは「知らない人と知り合ったり出会ったりすることを支援するサイト」のことです。狭義の出会い系サイトは、面識のない男女の交際のきっかけを提供するようなサイトのことですが、広義には、友達や趣味仲間を探すためのサイトや、相談相手を探すためのサイトも含まれます。ただし、インターネット異性紹介事業を利用して児童を誘引する行為の規制等に関する法律(通称:出会い系サイト規制法)で規制されている「インターネット異性紹介事業」は、狭義の出会い系サイトです。

狭義の出会い系サイトには、様々な問題点があります。これらのサイトは、無料のものが多いため、誰でも容易に利用できてしまいます。表面上はまじめな出会いを謳ったサイトでも、中に入るとみだらな書き込みがあったり、顔の見えない相手が、年齢や性別を偽って誘ってくることもあります。また、会員登録時にうっかり開示したメールアドレスが転売されて、広告メールを送りつけられることもあります。

警察庁の調べでは、2004年の出会い系サイトに関わる事件1,582件のうち、携帯電話を使用したものが1,519件(約96%)(加害者側が使用)で、被害者1,289人のうち、18歳未満の児童が1,085人(約84%)で大半を占めるという結果が出ています。児童買春・児童ポルノ禁止法違反のものが768件あり、出会い系サイトが児童買春などの児童に対する犯罪の温床になっていることがわかります。

近年のこうした状況を受けて、2003年に出会い系サイト規制法が制定されました。また、携帯電話事業者も自主規制として、決められたサイト以外へのアクセスを制限するサービスの提供などを行なっています。

また、一部の「まじめな」出会い系サイトでは、利用者からの書き込み内容をチェックしたり、管理者への通報機能を設けているところもあります。

コミュニティサイトとは、関心や興味を共有する人々が集まる、情報交換などのコミュニケーションを中心としたWebサイトのことです。

コミュニティサイトの種類としては、掲示板・チャットルーム、個人ホームページ・ウェブログ、SNS(ソーシャルネットワーキングサービス)、コミュニティサービスが挙げられます。

コミュニティサイトのメリットとしては、自分と同じ趣味や関心を持つ人を容易に見つけて、距離的制約を超えていつでもコミュニケーションをすることができること、現実社会のしがらみにとらわれない交流ができることがあります。また、自分の意見や新しい情報を自由に発信したり、最新の情報をすぐに入手できるといったメリットもあります。

しかし、コミュニティサイトの問題点もあります。参加者の匿名性が高いため、相手を信頼してよいかどうかの判断が難しく、年齢・性別の詐称やなりすましが可能です。また、サイトによっては無責任な発言が許容されるため、他人への誹謗・中傷が行われたり、はては殺害予告・爆破予告といった犯罪行為につながることもあります。

また自殺掲示板と呼ばれる、自殺志願者たちが集まる掲示板もあります。近年、この自殺掲示板で仲間を募って集団自殺をしたと見られる事件が頻発しています。このほか、家出掲示板というものもあります。これは、家出を希望している児童同士や、家出人を受け入れようとしている人が情報交換を行なう掲示板です。家出人を受け入れようとしている人の中には、児童買春を目的としている場合もあるようです。

コミュニティサイトの中には、ID等による利用者の識別で匿名性を軽減したり、利用規約の中で一定の行為を禁止したり、サイトへの通報機能を設けたり、管理人による管理・監視体制を敷いたりすることで、利用者による迷惑行為やトラブル発生を抑えようとしているところがあります。

ブロードバンドの普及に伴って、インターネット上で動画コンテンツを目にする機会が増えています。動画コンテンツには、映画やドラマ、ニュース、スポーツ、eラーニングなど生活に役立つものがたくさんありますが、アダルト動画の流通も増えています。

アダルトサイトでは、従来のような静止画から、動画の提供がメインになりつつあります。ブロードバンド化によって動画のファイルサイズが大型化し、解像度は大きく、再生時間は長くなっています。有料のコンテンツを閲覧するためにはクレジットカード番号入力等が必要になりますが、サンプル動画は無料で提供され、誰でも見ることができます。Webサーバを海外に置くことで、日本では違法な無修正の動画を配信するサイトもあります。

映画やビデオ、テレビ番組といった従来の映像コンテンツに対しては、映倫やビデ倫、放送基準等の業界による自主規制が存在し、一定基準を満たしたコンテンツでないと流通させることができません。一方、インターネット上のアダルト動画コンテンツ等については、現状では自主規制の枠組みがなく、どんなコンテンツでも容易に作成・発信することができます。

さらに、インターネット上の動画はデジタルコンテンツであるため、コピーが容易です。個人を盗撮した映像など人権を侵害しているような情報も、いったん流通してしまうと止めることができません。同じ有害コンテンツが、悪意のある利用者によって、色々な掲示板に掲載されてしまうこともあります。

また、ライブカメラと呼ばれる、街角やレジャー施設など特定の場所のリアルタイム映像をインターネットで配信するサービスがあります。このサービスを使って、道路の渋滞状況を確認したり、保育園での自分の子どもの様子を確認したりすることもできます。このような役に立つ使い方もある一方で、被写体の合意の下で私生活を覗き見るサイトも存在します。この場合、カメラの設置目的・意図によって、有害性を判断する必要があります。

動画コンテンツのフォーマット形式はいくつかありますが、コンテンツ作成時に、そのコンテンツが何歳向けであるかといった情報をコンテンツ本体に埋め込むことができるものもあります。こうした情報を使うことで、子どもに見せたくないコンテンツを利用者側でフィルタリングすることが可能になります。

インターネットの常時接続化とともに、オンラインゲームの利用者も増加しています。オンラインゲームとは、ネットワークを利用してゲーム会社が運営するサーバにアクセスし、そこにアクセスしている自分以外のプレーヤーと対戦したり、一緒に冒険したりするゲームのことです。PC向けオンラインゲームと家庭用ゲーム機向けオンラインゲームがあります。ジャンルはロールプレイングゲームが代表的で、他にシミュレーションゲーム、テーブルゲーム、囲碁・将棋などがあります。

オンラインゲームには無料のものやパッケージ販売のものもありますが、主流のロールプレイングゲームではソフト本体は無料で、月額1,500円程度の利用料金を取るものが多いようです。利用者に飽きられずに長く利用してもらうためには、ゲームの「コミュニティ性」が重要となります。例えば、ギルドと呼ばれる仲良しグループでの冒険を演出したり、アイテムに多様性を持たせることで利用者を個性化させたり、出会いやチャット等を通じた「バーチャルな生活空間」を創出したりすることで、利用者を長い時間ゲームに惹きつけるのです。

オンラインゲームには、ゲームを通じてネットの向こう側の人と知り合ったり、力を合わせて冒険したりといった良い点もあります。その反面、有害と思われる側面もあります。例えば、ゲームによっては利用者が他の利用者のキャラクターを殺して、殺したキャラクターのアイテムを略奪することができます。貴重なアイテム欲しさに、他人のIDとパスワードで勝手にログインしてアイテムを盗んでしまうという事件(これは不正アクセス禁止法違反に当たります)も起こっています。また、アイテムの現金取引も活発に行われており、数万円で売買されるアイテムもあります。ゲーム内で入手したアイテムを売ることで生計を立てる利用者が出てくるかもしれません。

また、ゲーム中毒、あるいはネット依存の問題があります。韓国ではオンラインゲーム中毒が社会問題になっており、インターネットカフェでオンラインゲームを3日間飲まず食わず、不眠でやり続けた利用者が死亡する事件も起きています。日本でも、不登校や引きこもりとネット依存との関係が指摘されています。

P2P(ピア・トゥー・ピア)とは、不特定多数の利用者間で直接に情報のやり取りを行うインターネットの利用形態のことです。常時接続化やブロードバンド化の進展とともに、P2Pの利用も拡大しています。

P2Pの特徴としては、コンテンツデータの交換において、サーバコンピュータや一部のネットワークに負荷が集中しないということが挙げられます。そのため、P2Pはブロードバンドコンテンツのような大容量のコンテンツを流通させるのに適した利用形態と言えます。

P2Pの仕組みを使ったソフトの代表例として、ファイル交換ソフトがあります。有名なファイル交換ソフトとして、NapsterやGnutella、WinMX、Winnyなどが挙げられます。これらのファイル交換ソフトを使うと、利用者間で効率的にコンテンツを共有できるという利点がありますが、問題点もあります。

まず、ファイル交換ソフトを用いて、音楽ファイルや映像コンテンツ、PC用ソフトなどの不正コピーが流通していることです。米国ではP2Pファイル交換ソフトの先駆けであるNapsterが、音楽ソフトの著作権を侵害しているとして2001年に違法判決を受けています。日本でも、Winnyの開発者が著作権法違反幇助容疑で逮捕されるという事件が起きています。また、ファイル送信者の匿名性が高く、通信時にデータの暗号化等が行われていることから、わいせつ画像や児童ポルノといった違法情報の交換に使われることもあります。

また、ファイル交換ソフトの利用によって、ネットワークのトラフィックが増大しているという問題もあります。あるインターネット接続サービスプロバイダ(ISP)は、ファイル交換ソフト利用が上りトラフィックに占める割合が60~80%であるとの発表をしています。

こうしたP2Pによる無秩序なファイル交換を制限するために、ISPの中には会員規約において、「通常の利用を超えた大量の通信量の発生」を禁止しているところがあります。また、特定のファイル交換ソフトの使用をブロックしたり、帯域(通信量)を制限できる専用ソフトウェアも販売されています。

ただし、ファイル交換ソフトの通信全体を制限すると、有益なコンテンツを効率よく流通できるというP2Pの良い側面も損なわれてしまいます。P2Pの良い部分は生かすような対応方法について今後、検討していく必要があります。

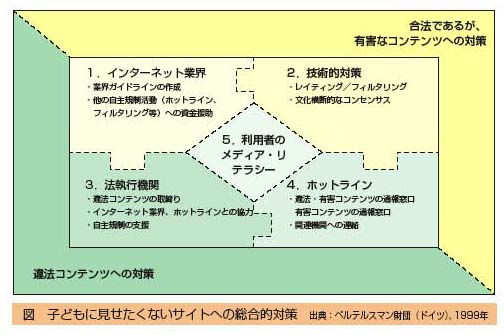

子どもに見せたくないサイトへの対応策のモデルとしては、ドイツのベルテルスマン財団(BertelsmannStiftung)による全体イメージが参考になります(下図)。

この図では、(1)インターネット業界による自主規制、(2)レイティング/フィルタリングによる技術的な対策、(3)法執行機関による法規制、(4)NPO等によるホットラインおよび(5)利用者のメディアリテラシーの向上、という5つの対応策からなる総合的な対策が提案されています。

この図に基づき、次のページから、それぞれの対応策について、日本における取組み状況を見ていきます。

インターネット業界による取組みには、いくつかの方向性があります。

多くのインターネット接続サービスプロバイダ(ISP)は、会員による違法情報や有害情報の発信を制限するために、利用規約を設けています。規約では、会員から違法・有害情報の発信があった場合には、その情報の発信停止を求めたり、情報を削除できることになっています。そして、繰り返しそのような情報の発信が行なわれる場合は、会員の利用停止や契約解除を行なえることなども定めています。また、利用者がサイト上でそうした違法情報や著作権侵害、プライバシー侵害行為などを発見した場合にISPに報告できるように、通報窓口を設けているところもあります。最近では、子どものいる会員向けに、月額制のフィルタリングサービスを提供しているISPも増えてきています。

一方、ポータルサイトによる取組みもあります。子どもがインターネットを使って犯罪やトラブルに巻き込まれるケースが増えていることから、子どもが安全にインターネットを利用するためのルールを提示したり、保護者向けのガイドラインを掲載しているところがあります。また、子ども向けの検索エンジンを提供しているポータルサイトもあります。子どもにとって安全と思われるページだけを表示するような、キッズポータルです。ブラウザ起動時のホームページにこうしたキッズポータルを設定しておくことで、子どもが有害サイトにアクセスすることをある程度防ぐこともできます。

フィルタリングソフトは、インターネット上の有害情報を子どもに見せないようにするためのソフトウェアです。フィルタリングソフトを使うと、情報を発信する人の表現の自由を奪うことなく、情報を受け取る側で有害なサイトの閲覧を拒否することができます。

インターネット協会では、有害情報を子どもに見せないようにするための手段の一つとして、フィルタリングソフトを推奨しています。

フィルタリングソフトでは、インターネットで発信された情報に対し、その情報の善し悪しのレベル、あるいはその情報が分類されるカテゴリ別というように、予め定められた基準に基づき、フィルタリングソフト会社がリストアップを行っています。保護者は、自分の考えにあわせて、受信を拒否するレベルやカテゴリなどを設定することで、子どもに有害情報を見せないようにします。

詳しくは、インターネット協会が発行しているパンフレット「フィルタリングソフトのしくみ」と「フィルタリングしてみよう」をご覧ください。

ただし、フィルタリングソフトを使えば万全ということではありません。フィルタリングソフトを使っても子どもに見せたくない情報をブロックできないことはありますし、子どもに見せたい情報がブロックされてしまうこともあります。

また、フィルタリングソフトで特定のサイトをブロックすることによって、逆に子どもがそのサイトに関心を示してしまうこともあります。「絶対に見てはいけません」と言われると、見たくなることがあるかもしれません。

一方、子どもに対して保護者がフィルタリングソフトを強制すべきでないという考え方もあります。子どもにインターネット上のいろいろな情報に触れさせて、自分で情報を取捨選択したり、善し悪しを判断するスキルを身につけさせるべきだという考え方です。

大切なことは、子どもたちがインターネット上に氾濫する情報の中から役に立つ情報を選び出したり、他人と上手にコミュニケーションをとったりするスキルを身につけることです。

そのためには、フィルタリングソフトの仕組みや特徴を正しく理解して、状況に応じて効果的に使うことが重要です。そして、保護者もパソコンやインターネットの使い方を学び、子どもがインターネットで何をしているかを理解し、子どもにインターネットの利用ルールについて教えたり一緒に考えていくことが必要です。

クオリティラベルは、JISマークやJASマーク、ウールマークのように、その製品やサービスの品質を第三者機関が評価し、一定基準を満たしていると認定されたことを示す情報のことです。ホテルやレストランの格付けも、クオリティラベルの一つです。

インターネット上では、あるサイトやコンテンツが第三者機関の評価や審査を受け、特定の対象者に対して推奨あるは禁止されたものであることを示す情報のことを言います。インターネット上のオンラインマーク、安全安心マーク、プライバシーマーク等がこれに該当します。

映画やビデオ、ゲーム等については、映倫管理委員会、日本ビデオ倫理協会、コンピュータエンターテインメントレーティング機構(CERO)などコンテンツを審査して「成人指定」などの年齢区分を行う機関が存在します。インターネット上のコンテンツについては、膨大な数のコンテンツが存在することもあり、まだそのような仕組みはありません。ただし、子ども向けのサイトを集めてカテゴリ毎にリスト化し、子ども向けの検索エンジンとして提供しているサイトはあります。

また、教育情報ナショナルセンター(NICER)がインターネット上の日本の教育用コンテンツに対し、LOM(Learning Object Metadata)という学習コンテンツ用の属性情報を付与して整理し、NICERのサイト上で様々な検索を行えるようにしています。

欧州では、インターネット上の医療情報に対して属性情報を付与し、患者や消費者が不正確・有害な医療情報はフィルタリングし、質の高い医療情報を選択できるようにするプロジェクトが進められています。このような事例に、今後のフィルタリング技術が向かうべき方向が示されているのかもしれません。

風俗営業適正化法の正式名称は「風俗営業等の規制および業務の適正化等に関する法律」です。同法の改正法は1998年5月に公布され、1999年4月1日から施行されています。風俗営業適正化法はその後何回か改正され、2004年には最終改正がなされています(平成16年法律147号)。

ISPに対する規制としては、ISPが自らのサーバ上にコンテンツプロバイダ(情報発信者)がわいせつな映像または児童ポルノ映像を記録したことを知ったときは、ISPは当該映像の送信防止のための必要な措置を講ずるよう努めなければならないとする努力義務規定があります。しかし、違法(わいせつや児童ポルノ)ではないが有害な映像(例えば、ヌードや性行為の映像)については対象外とされています。

コンテンツプロバイダ(情報発信者)に対する規制としては、インターネット上でアダルト映像(ポルノ的な映像。必ずしも違法な映像ではない)を有料で送信する業者は都道府県公安委員会に届け出なければならないとされています。罰則規定があり、違反者は30万円以下の罰金刑を科されます。また、上記業者は18歳未満の者を客としてはならず、利用者から18歳以上の証明等を受ける前に映像を送信してはなりません。この規制に違反して18歳未満の者を客とした場合には、公安委員会によって18歳未満の者を客としないため必要な措置を命じられます。

ただし、ポルノ画像を送信するアダルトサイトの中には、バナー広告を表示して広告主から広告収入を得ることにより、無料で利用者に映像を送信しているサイトも多くあります。これらのサイトは同法による取締りの対象外となります。

出会い系サイト規制法の正式名称は「インターネット異性紹介事業を利用して児童を誘引する行為の規制等に関する法律」です。同法は2003年6月13日公布され、同年9月13日から施行されています。

同法は、インターネット異性紹介事業者(いわゆる「出会い系サイト」)に対して、利用者への児童(18歳未満)の利用禁止の伝達、利用者が児童でないことの確認を義務付けるものです。インターネット異性紹介事業者が公安委員会の是正命令に違反した場合は、6ヶ月以下の懲役または100万円以下の罰金刑に科されます。

また、出会い系サイトを利用して児童を性交等の相手方となるように誘引すること、対償を示して児童を異性交際の相手方となるように誘引することについても罰則を設けています。違反した場合は、100万円以下の罰金刑に科されます。さらに、児童を誘引した大人だけでなく、大人を援助交際に誘った児童も罰則の対象となるのが、この法律の特徴です。

同法では、国及び地方公共団体の責務として、児童による出会い系サイトの利用防止に資する技術の開発及び普及推進を行なうことが努力義務として定められています。また、出会い系サイト規制法に対する附帯決議の中で、政府はフィルタリング機能を始めとする児童の利用防止のための技術開発や普及について官民一体となって取り組むこととされています。

インターネット上では国境を越えて情報が流通するため、ある国で違法とされる情報も他の国のサイト上で容易に閲覧できてしまうケースがあります。したがって、インターネット上の違法情報の規制には国際的な協調が不可欠であると言えます。

日本には従来、児童ポルノを取り締まる法律がなかったため、1996年にスウェーデンで開催された「児童の商業的性的搾取に反対する世界会議」において、日本は児童ポルノの発信基地だとする国際的批判が集中しました。そのことが1999年の児童買春・児童ポルノ禁止法の制定につながったという経緯があります。

児童買春・児童ポルノ禁止法の正式名称は、「児童買春、児童ポルノに係る行為等の処罰及び児童の保護等に関する法律」です。同法は1999年5月26日に公布され、同年11月1日から施行されています。また2004年6月18日に改正されています。

同法では、児童ポルノを提供したり、提供目的で製造・所持・運搬・輸出入したり、製造したりすることに対し、3年以下の懲役または300万円以下の罰金を科しています。児童ポルノを不特定もしくは多数の人に提供したり、公然陳列したり、これらの目的で製造・所持・運搬・輸出入することに対しては、5年以下の懲役もしくは500万円以下の罰金、またはこれらの併科を科しています。これらは、インターネット上で児童ポルノ画像を提供したり掲載する場合についても適用されます。また、日本国民が国外でこのような行為を行なった場合も処罰されます。

自治体の取組みとしては、前述したように、有害図書類の規定などを含む青少年健全育成条例が各都道府県で制定されています。このうち、青少年のインターネット利用に関する規定を含む条例は、福島県、埼玉県、奈良県、大阪府、鳥取県などで制定されています。

例えば、大阪府においては2003年3月に青少年健全育成条例が改定され、インターネット上の有害な情報から青少年を保護するための規定が置かれています。この中で、学校(大学及び専門学校を除く)の管理者や、広く府民が利用できるパソコンを管理する者(インターネットカフェなど)に対して、青少年がパソコンを利用するときは、フィルタリングの活用を基本として、健全な成長を阻害するおそれのある情報から青少年を保護するように努力義務が定められています。

東京都においても、東京都青少年問題協議会が2005年1月に、青少年のインターネット利用における答申をまとめ、条例改正の提言を行っています。提言では、携帯電話事業者やISPなどの事業者に対し、利用者にフィルタリングサービスを提供し、青少年が利用する場合には契約時にフィルタリング利用を勧奨することに努めることとしています。インターネットカフェに対しては、青少年が利用する場合に、フィルタリング機能付き機器の提供に努めることとしています。さらに、保護者や関係者は、青少年が利用する場合に、フィルタリングソフトやサービスを利用させるとともに、青少年に対する教育に努めることとしています。また、都は青少年の判断能力の育成を図るため、普及啓発や教育の推進に努めることとしています。

ホットラインとは、インターネット上の違法な情報、とりわけ児童ポルノに関して利用者からの通報を受け、ISPや法執行機関に通知するなど、一定の対応方法をとる機関のことです。法執行機関によるオンラインパトロールや、ISPによる自主努力による違法情報の摘発・削除を補完する役割を果たしています。

日本では2000年12月に、インターネットに関する種々の問題の相談・通報窓口の実務担当者相互の情報共有や連携を目的として、インターネットホットライン連絡協議会が設立されています。

海外のホットラインとしては、英国のIWF(Internet Watch Foundation)や米国のNCMEC(National Center for Missing and Exploited Children)があります。IWFは1996年に設立された独立機関で、ホットライン業務のほか、レイティング・フィルタリングの普及促進、利用者の教育と啓発も行っています。NCMECは1984年に議会により、行方不明の児童及び児童搾取についての通報の受付を目的として設立された非営利団体ですが、連邦機関として扱われています。また、欧米のホットライン間の連携をとるフォーラムとしてINHOPE(Internet Hotline Providers in Europe Association)が1998年に設立されています。

インターネットは子どもに見せたくない情報をはじめ、様々な問題やトラブルなどが存在し、まさに現実社会を写す鏡です。そのため、インターネットに振り回されることなく、インターネットを使いこなすためには、トラブルを避けるための知識や、情報の善し悪しを判断するためのスキル、他人に迷惑をかけないためのルールやマナーといった、メディアリテラシーを高めていく必要があります。

インターネット協会(旧電子ネットワーク協議会)では、「インターネットを利用する方のためのルール&マナー集」(初版1999年、その後2005年に改訂)において、インターネット利用にまつわるトラブルを回避し、ネットを安全で快適に利用できることを目的に、ネット利用のルールとマナーを公表しています。また、上記ルールとマナー集の「こどもばん」(初版1999年、その後2004年に改訂)において、子どもおよび保護者向けにインターネットの利用方法をわかりやすく説明しています。

また、2003年より、「インターネットにおけるルール&マナー検定」を同協会のWebサイトで逐次実施しています。「インターネットを利用する方のためのルール&マナー集」を身につけることを目的に、知識を客観的に測定するものです。2004年からは、子ども向けの検定も開始しています。

子どもがインターネットで何をしているか、保護者が全てを把握しているわけではありません。(社)日本PTA全国協議会が2003年11月~12月に実施した「青少年とインターネット等に関する調査」では、子どもに自由にインターネットを使わせている保護者は小学5年生で51%、中学2年生で80%にも上っています。また、「自分のインターネットの知識は子どもと同等かもしくは子どものほうが詳しい」と答えた保護者は,小学5年生で39%,中学2年生で59%になっています。

インターネット上には、従来からの有害情報や出会い系サイトといったコンテンツに加え、ブロードバンド化と常時接続化によって登場した新たなコンテンツがたくさんあります。P2Pソフトといった特殊なソフトウェアを使って、コンテンツが交換されることも増えてきています。子どもは新しい技術に対して敏感です。保護者の気づかないところで、過激なコンテンツにアクセスしたり、見知らぬ人とのトラブル利用者のメディアリテラシーの向上インターネット利用のルール&マナー保護者の教育・啓発に巻き込まれたりすることがあるかもしれません。

有害情報やトラブルを未然に防ぐために、子どものパソコンにフィルタリングソフトを入れることも大事です。しかし、フィルタリングソフトにだけ任せておけばよいわけではありません。

保護者もパソコンやインターネットについて学び、子どもがインターネットで何をしているのか、誰と会話しているのかについて話し合い、子どもにインターネットの利用ルールについて教えたり、一緒に考えていくことが必要なのです。

米国には、有害情報を規制する法律として児童オンライン保護法(Child Online Protection Act ,COPA)があります。同法は、児童をネット上のポルノから遠ざけるために、Webサイトはクレジットカード番号や成人IDなど成年者であることを証明する情報を入力しない利用者には一切有害な情報を見せてはならないとするもので、1998年10月に制定されています。

ただし、同法は非営利団体によって米国憲法修正第1条(言論の自由)に違反するものとして訴訟を起こされており、2004年6月には、連邦最高裁が下級裁判所による同法執行差し止めの仮命令を支持し、同法が違憲に当たる可能性があるとの判断を示しています。

また、児童インターネット保護法(Children's Internet Protection Act , CIPA)という法律もあります。これは、政府の援助金を受けている学校と図書館に、違法・有害サイトのフィルタリングを義務付ける法律で、2000年12月に制定されています。同法は、2002年5月にペンシルベニア州の連邦地裁により違憲判決を下されましたが、2003年6月には連邦最高裁が合憲とする判決を下しています。

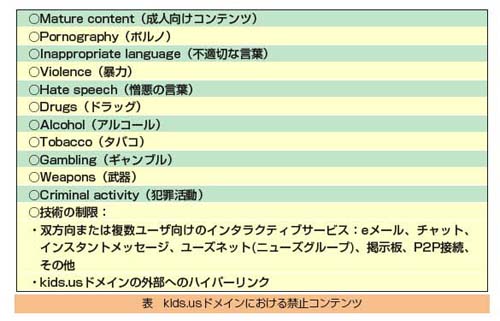

さらに、Dot Kids法(Dot Kids Implementation and Efficiency Act of 2002)という法律が2002年12月に成立しています。同法により、米国のトップレベルドメイン「.us」内に、13歳未満の児童が安心して利用できるサイト専用のセカンドレベルドメイン「.kids.us」が設けられました。kids.usドメイン内のサイトは、下品な言葉やポルノ、暴力、その他13歳未満の児童にとって不適切なコンテンツ、また、チャットルームやインスタントメッセージ、同ドメイン外のサイトへのリンクを含んではならないと定められています。

ドイツでは、1997年にマルチメディア法(正式名称は「情報通信サービスの基本条件の規制に関する法律」)と「メディアサービスに関する州際協定」が制定され、コンテンツプロバイダ(情報発信者)やISPに対し、自らのサービスが青少年に有害コンテンツを含む可能性がある場合は、自組織内に「青少年保護担当者」を設置することを義務づけています。担当者は、利用者との接触窓口となり、青少年保護の問題について事業者に助言を行ったり、特定のサービスを制限するよう勧告することができます。また、事業者は青少年保護担当者の設置に代えて、自主規制団体に上記の業務を代行させることもできます。この自主規制団体として設立された業界団体がjugendschutz.netやFSM(マルチメディアサービスプロバイダ自主規制協会)です。

有害コンテンツについては「青少年に有害な文書及びメディア・コンテンツの頒布に関する法律」で規定されています。1985年に制定された法律で、1997年に上記のマルチメディア法によって改正されています。これは、連邦審査会が文書やビデオ、Webコンテンツなどを審査し、青少年に有害だと判断すればその表現物を有害文書リストに掲載し、それらの青少年への提供を禁止し、販売方法や宣伝を制限するという内容です。有害文書としては、「非倫理的な文書」「粗暴化を助長する文書」「暴力、犯罪または人種差別を誘発する文書」「戦争を讃美する文書」が規定されています。

また、2003年4月からは「メディアにおける青少年保護州際協定」が施行されています。これはインターネットなどオンラインのメディアを規制するもので、コンテンツプロバイダ(情報発信者)に対し、青少年の成長を阻害すると思われるコンテンツについて、その流通形態に関わらず、青少年の年齢に応じて一定のアクセス禁止措置または制限措置を取ることを義務付けています。また、青少年メディア保護委員会(KJM)を設立しています。これは、放送、インターネット、その他のデジタルメディアにおける青少年保護を監督する国家機関で12人の専門家から構成されます。同委員会は、同州際協定の遵守を保証したり、自主規制団体を認可したり、コンテンツレイティング/フィルタリングシステム等の技術的手段を承認するといった役割を担っています。

韓国では、情報通信網利用促進法が2001年に改正されています。これは、インターネット上の性的・暴力的情報から青少年を保護するためにセルフレイティング制度を導入し、学校・図書館などの青少年が利用する施設に対して有害情報を遮断できるソフトの設置を推奨するものです。情報通信部の長官は、コンテンツプロバイダ(情報発信者)に対し、セルフレイティングを行なうことを推奨することができます。レイティングの基準は情報通信倫理委員会(ICEC:The Information and Communication Ethics Committee)が青少年保護団体などの意見を聞いて定めることになっており、SafeNetという基準を策定しています。青少年保護法上で定める有害情報を提供するコンテンツプロバイダ(情報発信者)は、それが有害情報であることを必ず表明しなければなりません。また、情報通信部の長官は、学校・図書館などの施設に対し、コンテンツに付与されたレイティング値を認識してアクセスの可否を選択できるソフトウェアを設置するように推奨することができます。

ICECは1995年に設立された政府機関で、韓国国内サイトをモニタリングし、有害サイトについてはセルフレイティングを推奨しています。また、国外の有害サイトについては国内法が及ばないため、有害サイトのレイティングデータベースを構築しています。市民から有害サイトの通報を受け付ける通報窓口も運用しています。

ICECはその他、フィルタリングソフトを開発しており、公益サービスとして公共機関およびソフト購買資金のない人々へ無償提供しています。また、多様な機能を持つ民間フィルタリングソフトの開発を促進したり、フィルタリングソフトの市場を創出するために、民間ソフトウェア企業にフィルタリング技術の移転を行っています。

EU委員会は1999年から2002年まで、「インターネットの安全利用の促進に関するアクションプラン(Safer Internet Action Plan)」という4ヵ年プログラムを実施しました。これは業界による自主規制を支援するためのプログラムで、総額2,500万ユーロの予算があてられました。支援領域は「ホットラインの欧州ネットワークの創出」「レイティング/フィルタリングシステムの開発」「インターネットの安全利用に関するアウェアネス向上」の3つでした。

2003年には同アクションプランを2年間延長することが可決され、フェーズ2のプログラムは2003年から実施されています。フェーズ2では、従来のWebコンテンツに加え、携帯電話コンテンツや、ブロードバンドコンテンツ(特に動画)、チャットルーム、インスタントメッセージ、P2Pによるファイル交換、オンラインゲームといった新しい技術への対応が求められています。

さらに、2005年からは4ヵ年計画で「Safer Internet Programme」が開始されています。

PICS(Platform for Internet Content Selection、インターネットコンテンツ選択のための技術基盤)とは、Web技術標準化団体であるW3C(World Wide Web Consortium)がインターネットの社会的責任を技術的に解決するために、1995年夏から開発を進めてきたレイティングとフィルタリングのための技術基盤です。

PICSの特徴は、インターネットにおける情報発信を制限することなく、受信者が設定するレベルに合わせて、選択的に情報を受信(フィルタリング)できるようにするところにあります。PICSの仕様書では、レイティング情報の記述方法と提供方法、レイティング基準の記述方法、フィルタリングルールの記述方法という3つの方法が定義されています。

W3Cは、PICS仕様に沿ったフィルタリングソフトやレイティング基準については提供せず、それらは外部の団体の活動に任せられています。例えば、マイクロソフト社のブラウザであるInternet Explorer3.0以降、またネットスケープ社のNetscape Communicator 4.5以降(6.0未満)にはPICS準拠のフィルタリング機能が組み込まれています。また、RSAC(Recreational Software Advisory Council)やICRA(Internet Content Rating Association)、インターネット協会などがレイティング基準を公開しています。

フィルタリングを実現するためには、ソフトウェアやレイティング基準の他に、コンテンツプロバイダ(情報発信者)自身がWebページに対してレイティングする(セルフレイティング)か、流通している情報に第三者が付加的なレイティングを行う(サードパーティ・レイティング)ことによるレイティングデータベースが必要です。様々な価値観に基づく複数のレイティングデータベースの中から、受信者の選択に基づきレイティング情報を参照することで、受信者による主体的な情報のコントロールが可能になります。

ICRA(Internet Content Rating Association)は1998年10月に設立された英国の独立非営利団体で、国際的なレイティング基準の策定とセルフレイティングの普及を推進しています。2000年12月には、従来の国際的レイティング基準であるRSACi(RSAC on the Internet)基準に代わる新たな国際的基準として、ICRA基準を立ち上げています。ICRAはその後、ICRA基準に基づくセルフレイティングツール、ICRAフィルター等のツールを提供しています。

世界各国のコンテンツに対して同一基準でセルフレイティングを行なうためには、レイティング基準の解釈が国や文化によって変動することのないようにすることが重要です。RSACi基準ではカテゴリごとの主観的な数値評価を必要としたのに対し、ICRA基準では主観的な判断は排し、「性器の描写を含む/含まない」「殺人の描写を含む/含まない」といった客観的な記述の積み重ねによってレイティングを行っています。また、「芸術的な文脈」「教育的な文脈」「医学的な文脈」など、コンテンツの作り手の意図を、レイティング情報に含めることが可能です。

英国の携帯電話事業者6社は2004年1月19日に、携帯電話コンテンツの自主規制のための行動規範(UK code of practice for the self-regulation of new forms of content on mobiles, 19th January 2004)を策定しています。

その主な内容としては、携帯電話事業者または携帯電話事業者と契約を結んだコンテンツプロバイダ(情報発信者)が提供するコンテンツ(いわゆる「公式サイト」)については、コンテンツプロバイダ(情報発信者)は18歳未満にふさわしくないとみなされる全てのコンテンツ(18禁コンテンツ)を自ら分類しなければいけません。各携帯電話事業者は、18禁コンテンツの表示に先立ちアクセスコントロールの実施が義務づけられました。すなわち、18歳以上という年齢認証を行った後にのみ閲覧可能としなければなりません。

他方で、携帯電話事業者のコントロールが及ばないコンテンツ(いわゆる「勝手サイト」)については、携帯電話事業者は親や保護者向けにフィルタリング機能を提供しなければなりません。フィルタリング機能は、上記18禁コンテンツと同等なコンテンツをブロックするようなレベルに設定します。フィルターは端末レベルではなく、ネットワークレベルで適用されます。

この行動規範を受けて、2004年7月にはVodafone UKが「公式サイト」向けのアクセス制限/フィルタリングサービスを発表しています。初期設定ではこのアクセス制限/フィルタリングがONになっており、解除するためには、クレジットカード番号を登録するか、ボーダフォンショップを訪問して、18歳以上であることを証明することが必要です。 「チャット」「出会い系サイト」「アダルトコンテンツ」「ギャンブル/賭け」「暴力的なゲーム」が、18禁コンテンツと分類されています。Vodafoneのチャットルームでは、18歳未満の子どももアクセスできるように、有人監視を行ない、連絡先情報やその他の不適切な情報が交換されないように管理を行っています。

我が国もこのような海外の取組みと連携して、取組みを進めていく必要があります。

このパンフレットの中で紹介した内容に関連する情報は以下の通りです。